Книга: Логика случая. О природе и происхождении биологической эволюции

Эволюционная энтропия и сложность

Эволюционная энтропия и сложность

Немногие модные слова в последние два десятилетия были настолько популярны и в то же время определялись столь разнообразно, зачастую противоречиво, а иногда и обманчиво, как сложность[68]. Несмотря на эту суету, понятие сложности, очевидно, отражает общее, фундаментально важное явление, пронизывающее всю биологию и выходящее за ее рамки. В отличие от многих научных терминов, «сложность» имеет конкретное значение в обыденном языке. Мы узнаем ее, как и порнографию[69], с первого взгляда. Все признают, что млекопитающее или птица сложнее, чем червь, а червь сложнее, чем любой одноклеточный организм. Говоря интуитивно, здесь присутствует дополнительный оттенок, устанавливающий пропорциональность сложности с «развитостью» или «приближением к совершенству».

Поднимаясь уровнем выше чистой интуиции, спросим, что означает большая сложность млекопитающего по сравнению с амебой? Этот вопрос очень важен, если мы стремимся выработать удовлетворительный ответ на известный вопрос: почему вокруг нас существуют слоны и секвойи (даже если их все меньше и меньше), а не одни лишь бактерии и археи с необходимыми и достаточными для функционирования минимальной клетки комплектами генов? Другими словами, какие факторы ведут к появлению сложности в процессе эволюции? В главе 7 мы обсуждали эволюционные сценарии, пытающиеся объяснить, как могла возникнуть поразительно сложная (по сравнению с клетками прокариот) организация эукариотической клетки. В этой главе мы столкнемся с озвученным выше вопросом «почему?» напрямую, и ответы на него будет неожиданными и, возможно, введут некоторых в замешательство.

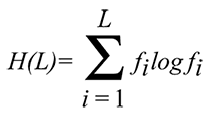

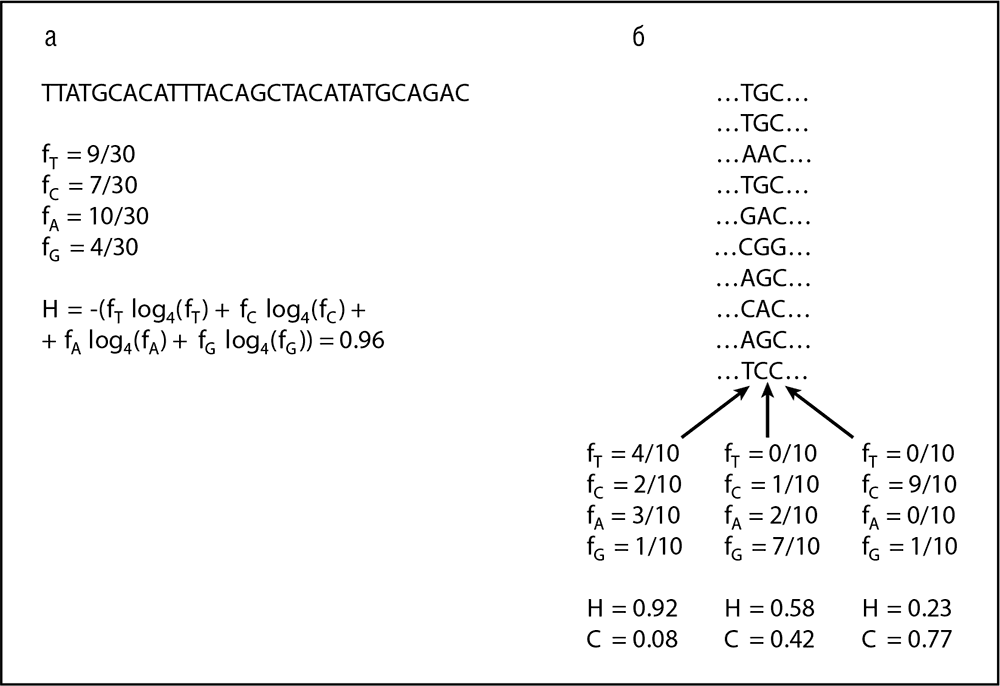

Точное определение организационной – или, в случае биологии, организменной – сложности по самой своей природе дается трудно. Попытки в этом направлении рассматривают различное число составляющих частей в сравниваемых системах[70]. Например, у позвоночных большее количество тканей и типов клеток, чем у червей, и это, естественно, приводит к утверждению, что позвоночные обладают большей организменной сложностью (Bonner, 2004). Для нашего рассуждения, однако, более важен тот факт, что эукариотические клетки имеют гораздо больше внутриклеточных органелл, чем клетки прокариот (те, как правило, вообще не имеют настоящих органелл). Эта разница, безусловно, отражает большую сложность организации эукариотической клетки. Кроме того, можно было бы в принципе измерить число взаимодействий между компонентами или число соединений в сетях передачи сигнала и на этом основании сравнивать сложность организмов или клеток. Однако все эти определения сложности, видимо, упускают «нечто», что мы интуитивно воспринимаем как неотъемлемое свойство сложной организации. В любом случае количественное сравнение организменной сложности, по-видимому, не приносит много пользы в реальных исследованиях. Геномная сложность определяется более естественно и может быть изучена подробнее. Действительно, в конце концов, геномные последовательности представляют из себя длинные строки цифровых символов (букв), а для этого класса объектов хорошо известны формальные, операциональные определения сложности. Вероятно, наиболее известным и наиболее интуитивно осмысленным из них является колмогоровская сложность, которая связана с шенноновской информацией и классическим статистическим определением энтропии по Больцману. Колмогоровская сложность – это просто длина кратчайшей строки символов, в которых может быть закодирована данная последовательность (геном). Очевидно, что наименее сложной последовательностью будет гомополимер (например, polyA), для которого длина сообщения составляет лишь одну букву, а сложность (информационное содержание) – 2 бита (в случае четырех нуклеотидов). Наиболее же сложная последовательность – полностью случайный полимер с равными частотами для всех четырех нуклеотидов (или 20 аминокислот, если мы примем это определение для аминокислотных последовательностей) в каждой позиции. Классическая формула Шеннона для энтропии (информационного содержания) нуклеотидной последовательности длины L (см. рис. 8–1а) может быть записана следующим образом:

Рис. 8–1. Содержание информации и сложность: а – одной последовательности; б – выравнивания гомологичных последовательностей; f обозначает частоты нуклеотидов в последовательности (а) или столбце выравнивания (б).

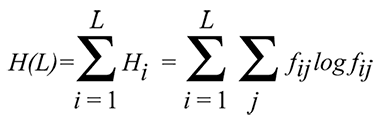

Здесь fi – частота символа i (i = A, T, G, C); далее, основание логарифма m считается равным размеру алфавита (4 в случае нуклеотидных последовательностей и 20 для аминокислотных последовательностей)[71]. Определенная таким образом, информация (энтропия) говорит нам очень мало об осмысленном информационном содержании или сложности геномной последовательности. Высокая сложность (энтропия или информационное содержание), очевидно, вовсе не предполагает, что последовательность сложна в каком-либо биологическом значимом смысле. Совершенно случайная последовательность на самом деле, скорее всего, бессмысленна, в то время как гомополимерная последовательность будет иметь ограниченный биологический смысл. Тем не менее почти случайная высокоэнтропийная последовательность может быть столь же функциональной, как и низкоэнтропийная последовательность, – способа узнать это просто не существует. Требуется биологически содержательное определение сложности, и такая попытка была сделана Крисом Адами (Adami, 2002) и несколько по-другому проинтерпретирована автором этой книги (Koonin, 2004). В соответствии с этим новым определением, энтропия и сложность рассчитываются для выравнивания ортологичных последовательностей, а не одной последовательности:

Здесь H(L) – полная энтропия выравнивания n последовательностей длины L, Hi – энтропия для сайта, а Fij – частоты для нуклеотидов (j = A, T, G, C) в сайте i[72]. Очевидно, для полностью консервативного сайта H(i) = 0, в то время как для совершенно случайного сайта H(i) = 1. Обратите внимание, что это определение энтропии полностью соответствует знаменитому статистическому определению Больцмана:

H = kln W

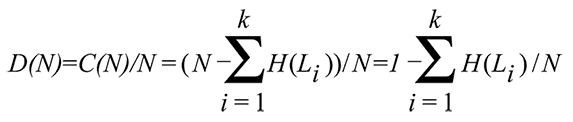

Здесь W — число микросостояний, соответствующих макросостоянию, для которого энтропия рассчитывается таким образом, что она равна нулю для полностью упорядоченного состояния и максимальна для полностью неупорядоченного состояния. Таким образом, определение эволюционной энтропии генома H(L), введенной предыдущей формулой, представляется физически корректным, следовательно, имеет смысл закрепить термин за обозначением этой величины. Эволюционная энтропия также имеет четкий биологический смысл: сайты с низкой энтропией сохраняются лучше и, как следствие, более важны функционально. Логично, что эти сайты несут больше информации о функционировании и эволюции рассматриваемых организмов – и о взаимодействиях между организмами и окружающей средой, что первоначально имел в виду Адами, – чем сайты с высокой энтропией (слабо сохраняемые, относительно неважные). Величина, которую можно определить как биологическую (эволюционную) сложность генома, определяется следующим образом:

Тогда биологическая (эволюционная) плотность информации может быть задана как:

Здесь N — общая длина (число нуклеотидов) генома, Li — длина геномного сегмента, подверженного измеримому отбору (как правило, ген), k — число таких сегментов в геноме, H(L) – эволюционная энтропия для сегмента L, рассчитанная по предыдущей формуле.

Точные значения H нелегко вычислить для полных геномов, поскольку распределение эволюционных ограничений никогда не известно точно (см. гл. 3). Кроме того, есть степень произвольности в выборе ортологов, включаемых для расчета в выравнивание. Тем не менее эти детали не столь важны, если нам нужна только приблизительная оценка. Действительно, доля сайтов, находящихся под отбором по всему геному, уже оценена с достаточной точностью для некоторых модельных организмов, таких как человек и дрозофила (см. гл. 3). Для других, в частности прокариот и одноклеточных эукариот, в качестве достаточного приближения можно взять долю кодирующих нуклеотидов плюс предполагаемую долю регуляторных сайтов; для участков под отбором за среднее значение энтропии можно принять H(i) = 0,5.

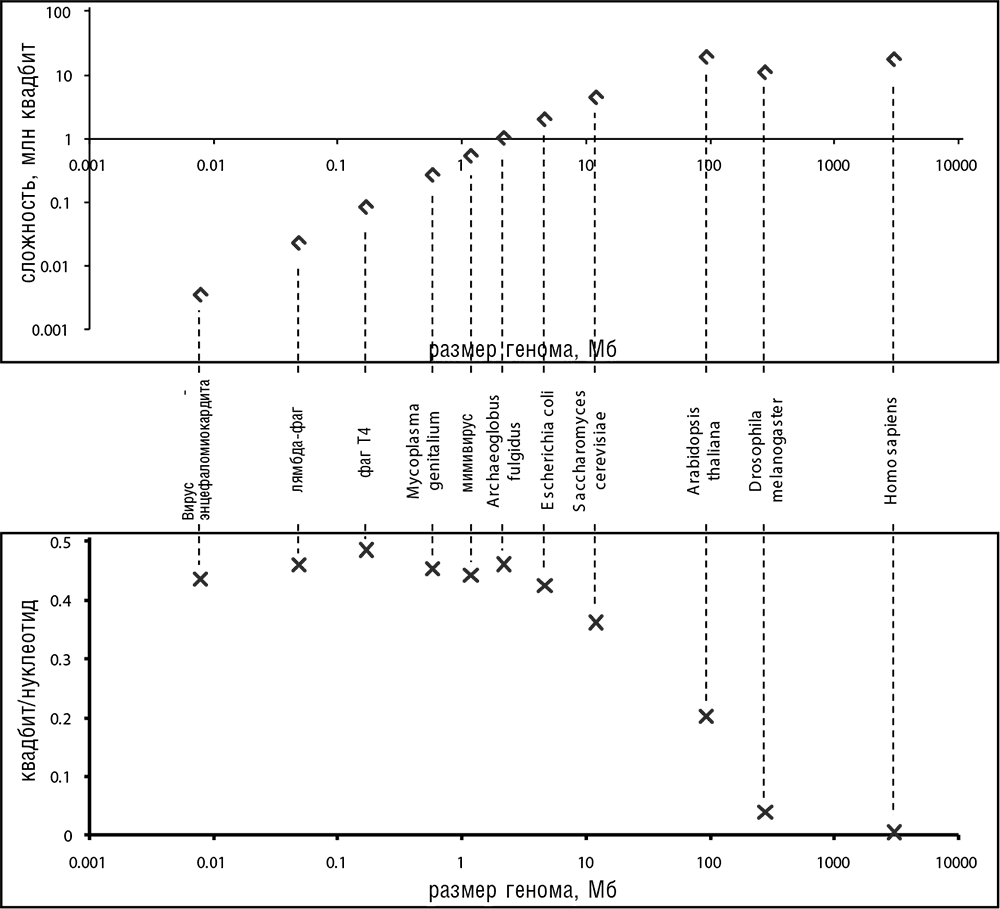

Сравнение оценок для H(N), C(N) и D(N) для геномов различных жизненных форм выявляет фундаментальный парадокс. Общая биологическая сложность C(N) монотонно возрастает с размером генома, в частности, для многоклеточных эукариот по сравнению с прокариотами, однако энтропия H(N) возрастает гораздо быстрее, в результате эволюционная плотность информации D(N) резко падает (см. рис. 8–2). Таким образом получается, что организмы, которые обычно воспринимаются как наиболее сложные (к примеру, человек), обладают «энтропийными» геномами с низкой или даже крайне низкой плотностью информации, в то время как организмы, которые мы традиционно считаем примитивными, такие как бактерии, обладают «информационными» геномами, в которых информация плотно упакована и плотность ее высока. Этот парадокс не даст нам много нового по сравнению с уже сказанным в главе 3 об организации различных геномов. Тем не менее поучительно формализовать понятие биологической сложности и выразить его в терминах энтропии, одного из ключевых понятий физики. Формальный разбор понятия сложности указывает на то, что «неладно что-то в Датском королевстве»: геномы организмов, которых мы вполне обоснованно считаем самыми сложными и наиболее «развитыми» (эта идея, возможно, менее оправдана), несут гораздо больше энтропии и, следовательно, имеют гораздо меньшую плотность биологической информации, чем геномы простейших клеточных форм. Перефразируя этот парадокс в более провокационной форме, геномы одноклеточных организмов (особенно прокариот) кажутся несравненно «лучше спроектированными», чем геномы растений и особенно животных.

Парадокс сложности подразумевает, что сложные черты организации геномов «высших» организмов (большие семейства паралогичных генов, сложная регуляция экспрессии генов, альтернативный сплайсинг и многое другое), вероятно, появились не в качестве прямолинейных адаптаций или «улучшений». Объяснение возникновения этих усложнений – большая проблема для эволюционной биологии; возможный ответ пришел в виде новой теории эволюции сложности, предложенной Майклом Линчем в 2003 году (Lynch and Conery, 2003).

Рис. 8–2. Зависимость эволюционной сложности C и плотности биологической информации D от размера генома. Точки – грубые оценки, полученные по приведенным в этой главе формулам, при условии Н(i) = 0,5 для несинонимичных сайтов в белок-кодирующих областях и Н(i) = 1 для других сайтов. График выполнен в двойном логарифмическом масштабе.

- Эволюционная энтропия и сложность

- Эффективный размер популяции как общая мера эволюционных ограничений: неадаптивная теория эволюции генома

- Генная архитектура эукариот: наглядная демонстрация неадаптивной теории эволюции генома

- От мусора к функциональности: важность ослабленного очищающего отбора для эволюции сложности

- Оптимизация генома в качестве основного пути эволюции и сложность как геномный синдром

- За пределами нулевой гипотезы: ограничения популяционно-генетического взгляда на эволюцию генома

- Дарвиновский глаз, нередуцируемая сложность, экзаптация и конструктивная нейтральная эволюция

- Краткий обзор и перспектива: неадаптивная эволюционная парадигма и переоценка концепции эволюционного успеха

- Рекомендуемая дополнительная литература

- Глава 5. Мощность и сложность

- Эволюционная эстетика

- Избыточность и эволюционная пластичность

- Развитие эмоций: эволюционная перспектива

- Рождение сложности. Эволюционная биология сегодня: неожиданные открытия и новые вопросы

- «Несократимая сложность»

- Два пола. Зачем и почему? Эволюционная роль разделения на два пола с точки зрения кибернетики

- Глава 8. Эволюционная психология

- Популяционная генетика, теорема Фишера, адаптивные ландшафты, генетический дрейф и «эволюционная тяга»

- Мультидоменные белки и сложность связей ортологов

- Оптимизация генома в качестве основного пути эволюции и сложность как геномный синдром

- Эволюционная динамика архитектуры генома прокариот: опероны, суперопероны и сети соседствующих генов